“Robôs assassinos” com Inteligência Artificial ameaçam a humanidade, diz ex-engenheira da Google

Entramos em um momento de nossa história em que tecnologias avançadas baseadas em Inteligência Artificial (IA) podem se tornar cada vez mais propensas a ações não intencionais que ameaçam a segurança e a autonomia dos seres humanos.

E aqueles entre nós que acreditam na segurança e autonomia dos seres humanos – a maioria no topo da atual pirâmide de poder – não precisam ficar cada vez mais vigilantes dessa ameaça crescente.

Os argumentos a favor e contra o desenvolvimento irrestrito da IA e sua integração nas capacidades militares são os seguintes: aqueles a favor do desenvolvimento da IA simplesmente apontam para o aumento da eficiência e precisão concedidas pelos aplicativos de IA.

No entanto, seu zelo desenfreado tende a basear-se em uma confiança bastante ingênua (ou fingida) na capacidade do governo, corporações e inteligência militar de se policiarem para garantir que a IA não seja desencadeada no mundo de maneira prejudicial aos indivíduos humanos.

O outro lado do argumento baseia sua desconfiança fundamental no desenvolvimento atual da IA, na noção bem documentada de que, de fato, nossos atuais líderes corporativos, governamentais e militares operam com base em sua própria agenda estreita, que pouco considera a segurança e a autonomia dos seres humanos.

Ninguém está argumentando contra o desenvolvimento da Inteligência Artificial como tal, para aplicação de maneiras que beneficiem clara e incontestavelmente a humanidade. No entanto, como sempre, o grande dinheiro parece ser disponibilizado em apoio à GUERRA, de um grupo de seres humanos tendo domínio e supremacia sobre outroS, em vez de aplicativos que irão beneficiar toda a humanidade e realmente ajudar a promover a paz no planeta.

Ex-engenheira da Google fala

Talvez não haja maneira de impedir completamente que os militares façam pesquisas sobre aprimoramentos de IA em suas aplicações. No entanto, parece haver uma linha clara de demarcação que muitos acham que não deve ser ultrapassada: dar aos programas de IA autoridade exclusiva para decidir se um determinado indivíduo ou grupo de seres humanos deve ser morto.

A engenheira de software, Laura Nolan, renunciou da Google no ano passado em protesto, após ser enviada para trabalhar em 2017 no Project Maven, um projeto usado para melhorar drasticamente a tecnologia militar de drones dos EUA e colocar muito mais ônus na IA para determinar quem e o que devem ser bombardeados ou alvejados. Ela sentiu que seu trabalho impulsionaria uma capacidade perigosa. Ela percebeu que a capacidade de converter drones militares, por exemplo, em armas autônomas não guiadas por humanos, “é apenas um problema de software atualmente e que pode ser resolvido com relativa facilidade”.

Por meio dos protestos e renúncias de pessoas corajosas como Laura Nolan, a Google permitiu que o contrato do Project Maven terminasse em março deste ano, depois que mais de 3.000 de seus funcionários assinaram uma petição em protesto contra o envolvimento da empresa. Deve ser indicativo para todos nós que esses grandes gigantes corporativos não tomam decisões éticas por conta própria, uma vez que são fundamentalmente amorais e continuam a exigir que os seres humanos envolvidos falem e tomem medidas para que os interesses da humanidade sejam considerados.

Robôs assassinos

Desde que se demitiu, Nolan continuou seu ativismo em meio a notícias sobre o desenvolvimento de ‘robôs assassinos’, máquinas de IA projetadas para operar autonomamente no campo de batalha, com a capacidade de matar grandes quantidades de combatentes inimigos. Ela pediu que todas as máquinas IA de matar não operadas por seres humanos fossem proibidas. Ela se juntou à Campaign to Stop Killer Robots (Campanha para Parar Robôs Assassinos) e informou diplomatas da ONU em Nova Iorque e Genebra sobre os perigos que as armas autônomas representam.

Ao contrário dos drones, que são controlados por equipes militares muitas vezes a milhares de quilômetros de onde a arma voadora está sendo usada, Nolan disse que os robôs assassinos têm o potencial de fazer “coisas calamitosas para as quais não foram originalmente programados”:

A probabilidade de um desastre é proporcional a quantas dessas máquinas estarão em uma área específica ao mesmo tempo. Há chances de ocorrer atrocidades e assassinatos ilegais, mesmo sob as leis da guerra, especialmente se centenas ou milhares dessas máquinas forem implantadas.

Pode haver acidentes em larga escala, porque essas coisas começarão a se comportar de maneiras inesperadas. É por isso que qualquer sistema avançado de armas deve estar sujeito a um controle humano significativo, caso contrário, eles devem ser banidos porque são imprevisíveis e perigosos demais. (Fonte)

Promessa de pesquisadores da IA?

Certamente, vemos manchetes populares como ‘Os principais pesquisadores da IA dizem que não farão robôs assassinos‘, onde supostamente foram feitas promessas:

Mais de 2.600 pesquisadores e engenheiros de IA assinaram um compromisso de nunca criar robôs assassinos autônomos, publicado hoje pelo Future of Life Institute. Entre os signatários estão Elon Musk, os co-fundadores da Alphabet, DeepMind, Mustafa Suleyman, Demis Hassabis e Shane Legg, além de Jeff Dean, da Google, e Yoshua Bengio, da Universidade de Montreal.

No entanto, isso não significa que podemos abandonar nossas postagens e confiar que as empresas que poderiam ganhar bilhões de dólares em contratos para avançar com essas aplicações automatizadas se recusarão a faze-los se acharem que podem se safar. De fato, são os olhos atentos e as poderosas palavras de pessoas conscientes que até agora impediram que isso acontecesse.

(Fonte)

Em resumo: em quem realmente não podemos confiar é no “macaco beligerante” chamado humano, que consegue transformar qualquer avanço tecnológico em armas para matar seus semelhantes. Os robôs em si somente estão cumprindo as ordens que neles foram programadas e daí possivelmente indo mais além.

E assim caminha a humanidade…

…E não esqueça: Nossa página principal é atualizada diariamente, com novos artigos podendo ser publicados ao longo do dia. Clique aqui.

ATENÇÃO: Qualquer artigo aqui publicado serve somente para cumprir a missão deste site. Assim, o OVNI Hoje não avaliza sua veracidade totalmente ou parcialmente.

IMPORTANTE: Se puder, colabore para manter o OVNI Hoje no ar. Cada doação, por menor que seja, é crucial para manter este espaço de informação e conhecimento disponível para todos os interessados. Ao utilizar o QR code do PIX abaixo ou a chave PIX “OVNIHoje” (sem aspas), você está desempenhando um papel fundamental na sustentação deste site.

As doações não são apenas um ato de generosidade, mas também uma demonstração do seu compromisso em apoiar o compartilhamento de informações relevantes e o crescimento da comunidade interessada em assuntos tão fascinantes, possibilitando a continuação das pesquisas, análises e publicações que enriquecem nosso entendimento.

Seja parte deste movimento contínuo em prol do conhecimento. O OVNI Hoje e seus leitores agradecem sinceramente por seu apoio dedicado.

Agradecimentos aos colaboradores do mês!

Muito obrigado!

ÁREA DE COMENTÁRIOS

(Mais abaixo…👇)

ATENÇÃO:

-Os comentários são de responsabilidade única e exclusiva de cada pessoa que comenta, portanto aja com responsabilidade.

-O OVNI Hoje não se responsabiliza por transtornos, rixas ou quaisquer outras disposições causadas pelos comentários.

-Comente educadamente e com ética, sempre tratando seu colega de comentários como você mesmo queira ser tratado.

-Comentários com “pregação” política ou religiosa, obsceno ou inapropriado serão prontamente apagados.

-Se não concordar com o que foi escrito por outros colega e quiser fazer um contraponto, limite-se a defender seu ponto de vista sem ataques pessoais. Aqueles que fizerem comentários com ataques pessoais diretos ou indiretos a outros participantes serão banidos.

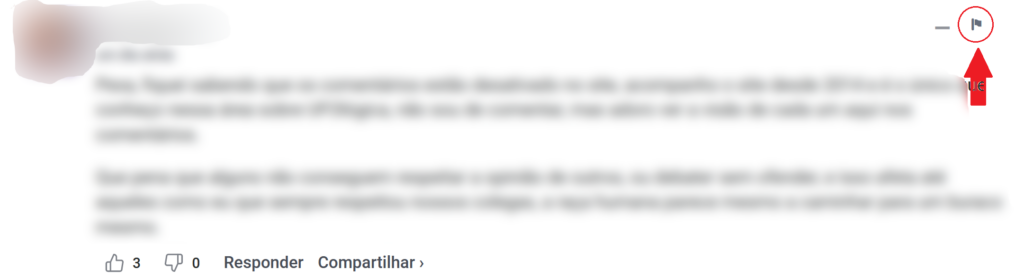

-AJUDE NA MODERAÇÃO JUSTA DA ÁREA DE COMENTÁRIOS: Como pode ser visto na foto abaixo, no canto superior direito de cada comentário há uma pequena bandeira que, quando clicada, marca um comentário como “inapropriado“. Utilize-o com responsabilidade para alertar os moderadores sobre alguém que não esteja seguindo as regras da área de comentários.

-O respeito mútuo é essencial para bom andamento da área de comentários. Evite ser banido.

-O USUÁRIO QUE TENTAR DESOBEDECER AS REGRAS ACIMA SERÁ BANIDO, SEM RECURSOS.